光计算加速器能否突破当前算力瓶颈?光计算加速器原理、应用与挑战解析

在人工智能与科学计算快速演进的当下,算力需求正呈指数级增长态势。当电子芯片逐步逼近物理极限,一场由光子技术引发的计算领域革新已悄然拉开帷幕。光计算加速器作为光学与计算科学深度融合的创新性技术,能否凭借其独特的物理属性,为当前算力困局提供突破性解决方案?本文将从技术原理、应用场景及发展挑战等维度展开系统性探讨。

一、电子计算架构的现实困境与光子技术的崛起逻辑

以GPU为代表的电子数字并行加速器,虽依托冯·诺依曼架构在通用计算领域取得显著成就,但在大规模并行计算场景中逐渐暴露出固有缺陷:随着半导体工艺进入3纳米以下节点,量子隧穿效应导致漏电流显著增加,短沟道效应引发载流子迁移率下降,电子器件的能效提升面临严峻物理限制;同时,晶体管电路能耗与时钟频率呈三次方关系,使得大规模数字电路的时延优化空间趋近于临界值。以GPT4训练为例,即便配置2.5万块NVIDIAA100GPU构建计算集群,仍需90100天方能完成训练任务,其能耗规模已成为行业发展的突出制约因素。

光子技术的兴起则为突破这一困局提供了新方向。光计算凭借两大核心物理优势,重构了计算逻辑框架:

带宽优势:光子器件带宽可达电子器件的10万倍量级,能够支持大容量频分复用并行计算模式。尽管小型电子模拟/数字电路可实现5GHz以上带宽指标,但实际计算系统受限于线延迟效应,运行速度往往远低于理论阈值,而光子器件动态响应速度已接近百GHz水平。

传输优势:硅基氮化硅波导在16001640nm波段的传输损耗仅为0.06dB/cm,几乎不存在焦耳热效应;相较之下,长距离电信号传输过程中,焦耳热效应与信号串扰问题显著,且能耗随传输距离呈线性增长态势。

二、光计算的核心技术原理:从光子调制到矩阵运算的实现路径

光计算加速器的底层技术逻辑,在于通过光信号的调制、检测及线性运算完成复杂计算任务。其核心功能单元——光学乘加(MAC)单元,构成了计算阵列的基础架构:

调制编码技术:光信号可通过光强调制、相位调制、光干涉及衍射元件等多种方式实现信息编码。例如,电光调制器(EOM)可通过电压信号动态改变光强,相位调制器则利用光波相位差特性完成信息加载。

检测转换机制:单端检测、双端检测、相干检测及阵列检测等技术,可实现光信号到电信号的高效转换。其中,阵列检测技术能够支持大规模并行数据采集,显著提升计算系统的实时处理能力。

并行计算架构:通过时分复用(TDM)、空分复用(SDM)、波分复用(WDM)及深度衍射神经网络(D2NN)等架构设计,光计算系统可实现多维度光信号的并行处理。基于TDM的光计算加速器能够在降低系统复杂度与成本的同时,有效减少电光调制器(EOM)的使用数量;SDM架构则是实现光计算高速并行化的基础方式之一,与其他复用策略结合后,可充分发挥光计算的高计算密度与低延迟特性,构建高效能计算系统。

三、应用场景拓展:人工智能与科学计算的双维度赋能

在人工智能领域,光计算加速器展现出颠覆性应用潜力。其大规模并行计算特性可显著提升模型训练与推理效率:在自然语言处理领域,光计算技术可快速完成Transformer架构中的注意力机制矩阵运算,将推理延迟降低至电子方案的千分之一量级;在计算机视觉领域,基于光卷积神经网络的目标检测模型,可借助光子的低延迟特性实现实时视频分析,其功耗仅为GPU方案的1/100。

科学计算领域同样受益于光计算技术的独特优势。对于以迭代算法为核心的计算问题(如数值模拟、量子化学计算等),光计算的低能耗与高带宽特性可大幅提升处理效率。基于逆向设计技术的超材料平台,能够在芯片级尺度高效求解微波频段的通用积分方程,为雷达仿真、电磁优化等场景提供实时计算支持。值得关注的是,大模型在4位精度下的训练可行性,为光学模拟计算开辟了应用新空间——其擅长的低精度、高速度计算特性,与人工智能及科学计算的部分核心需求高度契合。

四、技术挑战与商业化路径:从实验室到产业应用的关键跨越

尽管光计算技术前景广阔,但其产业化进程仍面临多重技术挑战:光学器件的高精度控制问题(如纳米级波导加工误差)、光电混合系统的接口损耗、模拟计算过程中的误差累积效应等,均亟待突破。此外,如何实现光学计算阵列与现有电子系统的兼容性,构建“光电协同”的异构计算架构,成为商业化落地的核心命题。

突破上述挑战需依赖跨学科创新协同:新型光电子材料(如二维材料石墨烯、氮化硼)的研发,可显著提升器件集成度与响应速度;自适应模拟电路设计与算法优化(如稀疏矩阵光计算),能够进一步降低计算误差;而行业生态体系的构建(如开源光计算框架、标准接口协议),将加速技术从实验室向产业应用的转化进程。

五、未来展望:光子计算时代的发展蓝图

张江实验室等研究团队的探索实践表明,光计算加速器已从理论研究阶段迈入原型验证阶段。展望未来,随着架构创新与工艺技术的成熟,其有望在以下领域率先实现商业化突破:

边缘计算领域:在自动驾驶、智能终端等场景中,光计算的低功耗特性可有效延长设备续航时间,同时实现传感器数据的实时处理。

数据中心场景:光互联技术与计算单元的深度融合,将显著缓解数据中心的“内存墙”与“功耗墙”问题,为万亿参数级大模型的高效训练提供支撑。

专用计算领域:在金融风控(投资组合优化)、通信信号处理(非线性失真补偿)等特定领域,光计算的定制化架构将展现出碾压性效率优势。

当摩尔定律渐近发展瓶颈,光子技术正接过算力革命的接力棒。这场由光信号驱动的计算变革,不仅是技术层面的突破,更是对计算范式的重新定义。在可预见的未来,“硅基电子+光子计算”的异构计算时代或将到来,为智能计算领域开启全新的发展纪元。光计算加速器能否最终突破当前算力瓶颈,不仅取决于技术创新的速度,更依赖于跨学科协作与产业生态的协同演进。

-

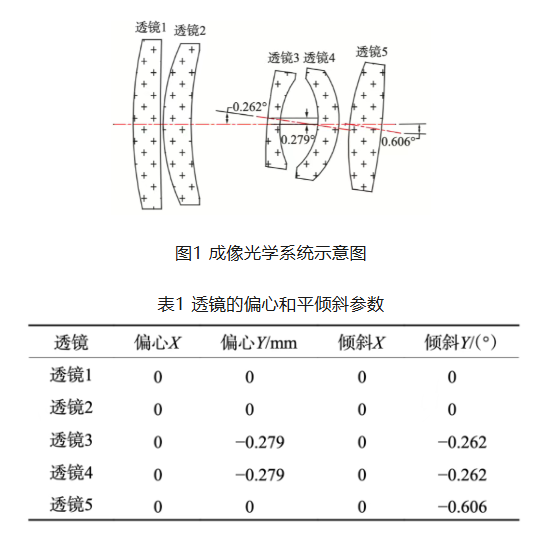

多基准轴透射式离轴光学系统高精度定心装调方法

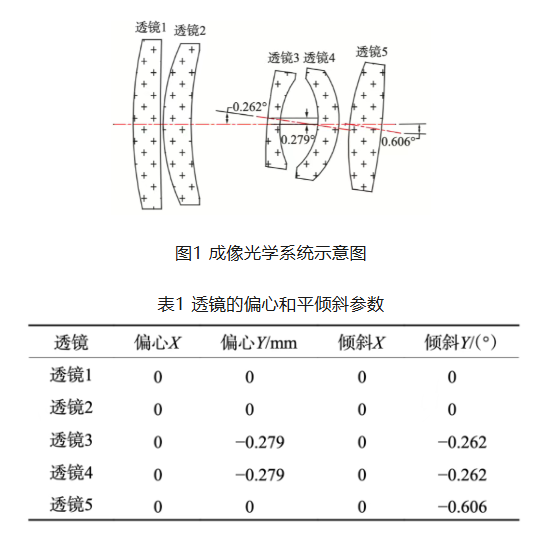

星载光谱仪可获取空间连续分布的光谱数据,是陆地植被监测、海洋环境探测等领域的核心载荷。为校正分光系统引入的畸变,星载光谱仪成像透镜多采用离轴透射式设计,由此形成的多光轴结构存在大倾角、大偏心特征,超出了传统同轴系统定心装调方法的适用范围。本文提出一种多基准轴定心装调方法(Multi-referenceAxisAlignment,MAA),通过镜筒结构一体化加工预置各光轴的偏心与倾斜参数,结合光学平板实现基准轴的高精度引出,将复杂多光轴系统的装调拆解为多个单光轴子系统的独立装调,突破了传统定心仪的测量范围限制。针对某星载光谱仪3光轴离轴透射系统开展装调验证,实测结果表明,透镜最大偏心误差小于25.4μm,最大倾斜误差小于17.7″,系统实际畸变与理论值平均偏差小于0.32μm,全面满足设计指标要求。该方法为离轴折射类光学系统的高精度装调提供了可行的技术路径,拓展了透射式光学系统装调的适用边界。

2026-05-22

-

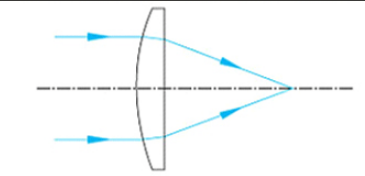

平凸透镜朝向对光束会聚效果及像差特性的影响分析

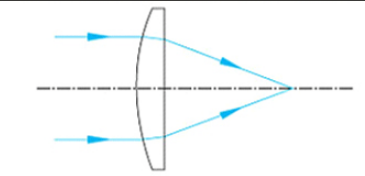

平凸透镜是各类光学系统中应用最为广泛的基础折射元件之一,属于典型的无限共轭透镜,核心光学功能分为两类:一是将点光源出射的发散光束准直为平行光束,二是将入射的准直平行光束会聚至单点。在激光光学、显微成像、光电检测等领域的光路设计与装调中,平凸透镜的安装朝向是直接影响系统性能的核心参数,其选择直接决定了像差水平与最终会聚效果。

2026-05-21

-

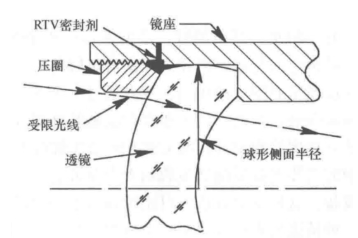

光机系统设计:镜头装配轴向预紧力计算(一)——通用设计原则与基础方法

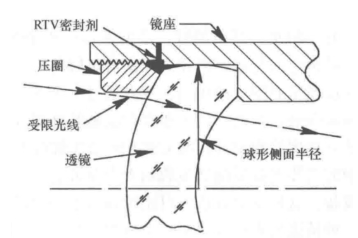

本文基于光机系统设计领域的经典工程理论,系统阐述镜头装配中透镜面接触安装技术的核心原理,明确轴向预紧力在透镜固定、精度保持与环境适应性中的关键作用,详细介绍标称轴向预紧力的基础计算方法、参数定义与适用边界,同时解析轴向预载对透镜自动定心、抗径向偏心的力学效应,为光学镜头的装调设计提供标准化的工程参考。

2026-05-21

-

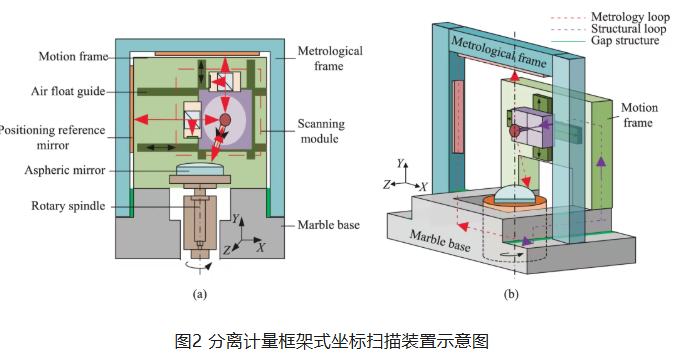

高精度轴对称非球面反射镜面形轮廓非接触式测量方法

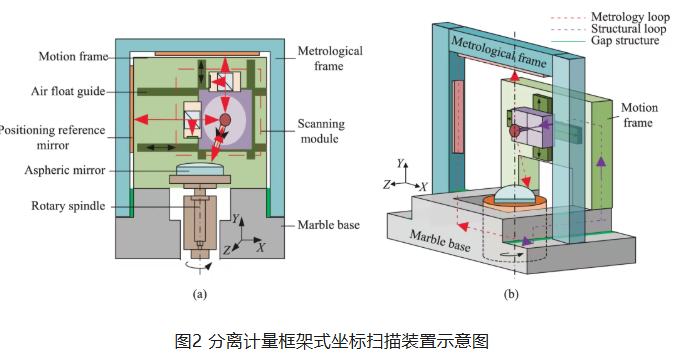

非球面光学元件是高端光学系统的核心器件,其面形轮廓的高精度、可溯源测量是保障加工质量与系统性能的关键。本文针对轴对称非球面反射镜的测量需求,建立了通用化的非球面扫描轨迹数学模型,提出一种基于独立计量回路的非接触式坐标扫描测量方法。该方法采用运动与计量分离的框架结构,有效隔离运动误差对测量结果的影响;测头采用集成阵列式波片的四象限干涉测量系统,实现1nm级测量分辨率;通过扫描执行机构与多路激光干涉系统共基准设计,实现测量值可溯源至“米”定义。试验验证表明,该方法测量误差小于0.2μm,重复性精度达70nm,整体测量精度达到亚微米级,为非球面测量的量值统一与溯源提供了成熟的技术方案。

2026-05-21

-

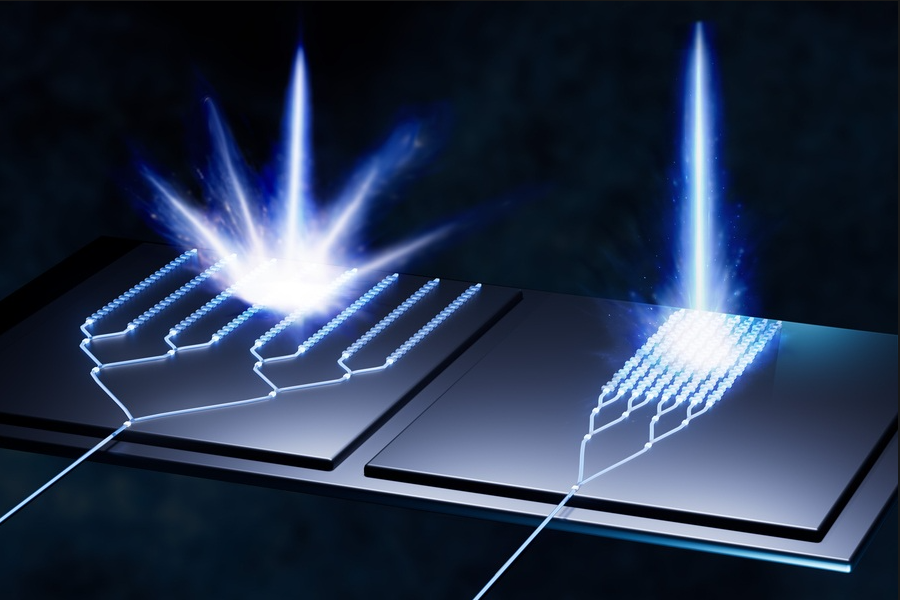

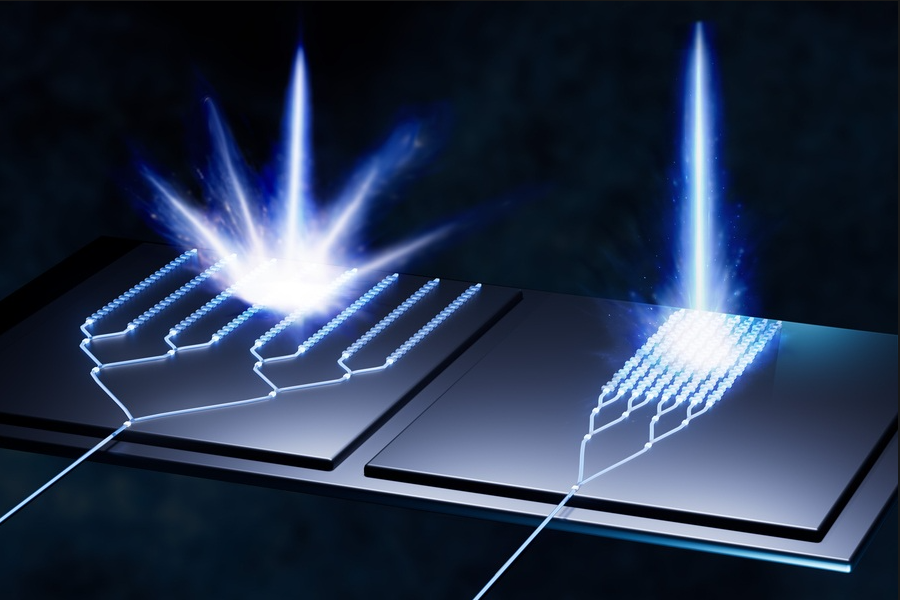

麻省理工学院固态激光雷达硅光子芯片核心突破解读

麻省理工学院研究团队攻克了硅光子集成光学相控阵(OPA)固态激光雷达的长期核心瓶颈,通过创新的低串扰集成天线阵列设计,首次实现了宽视野扫描+低噪声高精度的无活动部件激光雷达芯片,为下一代紧凑、高耐用性固态激光雷达的落地奠定了技术基础。

2026-05-20